Last Updated on Haziran 1, 2025 by EDİTÖR

Mayıs 2025’te bir postalamak sormak “[Am I the asshole] Kocamın ilişki partnerinin nişanlısını ilişkileri hakkında anlatmak için? ” Hızlı bir şekilde Reddit’in Posta’nın Trending Posts (AI) tarafından yazıldığı 900’den fazla yorum aldı.

Gönderi biraz içeriyordu kehanet stok ifadeleri kullanmak gibi AI işaretleri (“[my husband’s] Aile öfkeli ”) ve aşırı tırnak işaretleri ve gerçek bir ikilemi yansıtmak yerine öfke üretmek için tasarlanmış gerçekçi olmayan bir senaryoyu çizmek.

Bu yazı o zamandan beri forumun moderatörleri tarafından kaldırılmış olsa da, Reddit kullanıcıları tekrar tekrar ifade etti hayal kırıklığı bu tür içeriğin çoğalmasıyla.

Reddit’teki yüksek önlemli, AI tarafından üretilen yayınlar, düşük seviyeli etkileyicilerden koordineli siyasi etki operasyonlarına kadar herkes tarafından oluşturulan ve paylaşılan ucuz, düşük kaliteli AI tarafından oluşturulan içerik olan “AI slop” olarak bilinen şeyin bir örneğidir.

Tahminler tavsiye etmek LinkedIn’deki daha uzun İngilizce dillerinin yarısından fazlası AI tarafından yazılmıştır. Bu rapora yanıt olarak, LinkedIn ürün müdürü Adam Walliewicz, Wired’in “düşük kaliteli ve kesin ya da yakın bir yinelenen içeriği proaktif olarak tanımlamak için sağlam savunmalara sahip olduğunu söyledi. Bu tür içeriği tespit ettiğimizde, geniş bir şekilde tanıtılmadığından emin olmak için harekete geçiyoruz.”

Ancak AI tarafından oluşturulan düşük kaliteli haber siteleri Patlama her yerde ve AI görüntüleri de sel Facebook gibi sosyal medya platformları. Gibi resimlerle karşılaşmış olabilirsiniz “Karides İsa” kendi yemlerinizde.

AI tarafından üretilen içerik ucuzdur. 2023’ten NATO Stratcom Mükemmellik Merkezi tarafından bir rapor kurmak Sadece 10 € (yaklaşık 8 £) için, neredeyse tüm büyük sosyal medya platformlarında on binlerce sahte görüş ve sevme ve yüzlerce AI tarafından üretilen yorum satın alabilirsiniz.

Çoğu masum eğlence olsa da, bir çalışmak 2024’ten itibaren tüm internet trafiğinin yaklaşık dörtte birinin “kötü botlardan” oluştuğunu buldu. Dezenformasyon, kafa derisi etkinlik biletleri veya kişisel veriler çalmaya çalışan bu botlar da insan olarak maskelemede çok daha iyi hale geliyor.

Kısacası, dünya “ Web’den: Teknoloji şirketleri kullanıcı deneyimi üzerindeki kârlara öncelik verdikçe çevrimiçi hizmetler zamanla daha da kötüleşmiştir. AI tarafından üretilen içerik bunun sadece bir yönüdür.

Reddit yazılarından okuyucuları gözyaşı dökmeye kadar kedi videolarıbu içerik son derece dikkat çekici ve bu nedenle hem slop-creators hem de kazançlı platformlar.

Bu nişan yemi olarak bilinir – insanların yayın kalitesine bakılmaksızın insanları sevmelerini, yorum yapmasını ve paylaşmasını sağlamak için bir taktik. Ve buna maruz kalacak içeriği aramaya gerek yok.

Bir çalışmak Lahana sarılmış sevimli bebeklerin görüntüleri gibi katılım yeminin, herhangi bir AI-slop sayfası veya hesaplarını takip etmeseler bile sosyal medya kullanıcılarına nasıl önerildiğini araştırdı. Genellikle düşük kaliteli kaynaklara bağlanan ve gerçek veya makyaj ürünlerini teşvik eden bu sayfalar, hesabı daha sonra kâr için satmak için takipçisi tabanlarını güçlendirecek şekilde tasarlanabilir.

Meta (Facebook’un ana şirketi) Nisan ayında, “Spams” İçeriği Bu, “görünümleri artırmak için Facebook algoritmasını oynamaya” çalışır, ancak AI tarafından oluşturulan içerik belirtilmemiştir. Meta Facebook’ta kendi AI tarafından üretilen profillerini kullandı, ancak o zamandan beri Bu hesapların bazılarını kaldırdı.

Bunların hepsinin demokrasi ve siyasi iletişim için ciddi sonuçları olabilir. AI yapabilir ucuz ve verimli bir şekilde İnsan tarafından üretilen içerikten ayrılamaz seçimler hakkında yanlış bilgi yaratın. 2024 ABD başkanlık seçimlerinden önce araştırmacılar tanımlanmış Cumhuriyetçi meseleleri savunmak ve siyasi düşmanlara saldırmak için tasarlanmış büyük bir etki kampanyası.

Ve sadece Cumhuriyetçilerin bunu yaptığını düşünmeden önce, tekrar düşünün: Bu botlar önyargılı her perspektiften insanlar olarak. A rapor Rutgers Üniversitesi, siyasi yelpazenin her tarafındaki Amerikalıların tercih ettikleri adayları tanıtmak için botlara güvendiğini buldu.

Araştırmacılar da masum değil: Zürih Üniversitesi’ndeki bilim adamları son zamanlarda yakalanmış Reddit’te, unauthenhence yorumların insanların zihinlerini değiştirip değiştiremeyeceğine dair bir araştırma projesinin bir parçası olarak Reddit’te yayınlamak için yapay zeka ile çalışan botlar kullanmak. Ancak bu yorumların moderatörleri reddit için sahte olduğunu açıklayamadılar.

Reddit şimdi üniversiteye karşı yasal işlem yapmayı düşünüyor. Şirketin baş hukuk memuru söz konusu: “Bu Zürih Üniversitesi ekibinin yaptığı şey hem ahlaki hem de yasal düzeyde derinden yanlış.”

Rusya, Çin ve İran gibi otoriter ülkeler de dahil olmak üzere siyasi operatörler AI odaklı operasyonlar Demokratik dünyadaki seçimleri etkilemek.

Bu operasyonların ne kadar etkili olduğu tartışmaya hazır. Bir çalışma, Rusya’nın 2016 ABD seçimlerine sosyal medya aracılığıyla müdahale etme girişimlerinin bir dudakbaşka bir kurmak Trump için yoklama rakamlarını öngördü. Ne olursa olsun, bu kampanyalar çok daha sofistike ve iyi organize ediliyor.

Ve görünüşte apolitik AI tarafından üretilen içeriğin bile sonuçları olabilir. Bunun hacmi, gerçek haberlere ve insan tarafından üretilen içeriğe erişmeyi zorlaştırır.

Malign AI içeriğinin hem insanlar hem de bilgisayarlar tarafından tespit edilmesinin son derece zor olduğunu kanıtlamaktadır. Son zamanlarda bilgisayar bilimcileri tanımlanmış Makine tarafından oluşturulan içeriği (çoğunlukla kripto para birimi hakkında) yayınlayan ve beğeniler ve retweetler yoluyla birbirleriyle etkileşime giren yaklaşık 1.100 sahte X hesabı. Sorunlu olarak, Botometre (botları tespit etmek için geliştirdikleri bir araç) Bu hesapları sahte olarak tanımlayamadı.

Özellikle içerik formülsel veya unapologetically sahte olduğunda, ne arayacağınızı biliyorsanız AI kullanımının tespit edilmesi nispeten kolaydır. Ancak kısa biçimli içerik (örneğin Instagram yorumları) veya yüksek kaliteli sahte görüntüler söz konusu olduğunda çok daha zor. Ve AI eğimini oluşturmak için kullanılan teknoloji hızla gelişiyor.

AI trendlerinin yakın gözlemcileri ve yayılması yanlış bilgiolumlu bir notla bitirmek ve AI eğimini tespit etmek veya gücünü azaltmak için pratik ilaçlar sunmayı çok isteriz. Ama gerçekte, birçok insan sadece gemiyi atlıyor.

AI eğiminden memnun olmayan sosyal medya kullanıcıları Geleneksel platformlardan kaçmak ve yalnızca davetkar çevrimiçi topluluklara katılmak. Bu, kamusal alanımızın daha da kırılmasına ve aradığımız topluluklar genellikle oluştuğu için polarizasyonun daha da kötüleşmesine yol açabilir. benzer düşünen bireyler.

Bu sıralama yoğunlaştıkça, sosyal medya, çoğunlukla biz insanlar izlerken diğer botlarla etkileşime giren botlar tarafından üretilen ve tüketilen akılsız eğlenceye dönüşen riskler. Tabii ki, platformlar kullanıcıları kaybetmek istemiyor, ancak halkın tahammül edebileceği kadar AI eğimini zorlayabilirler.

Bazı potansiyel teknik çözümler AI tarafından oluşturulan içeriği etiketleme Geliştirilmiş bot algılama ve ifşa düzenlemesi yoluyla, belirsiz olmasına rağmen Bunlar gibi uyarılar pratikte ne kadar çalışıyor.

Bazı araştırmalar da gösteriyor söz İnsanların derin dişleri daha iyi tanımlamalarına yardımcı olmak, ancak araştırma ilk aşamalarında.

Genel olarak, sorunun ölçeğini fark etmeye başlıyoruz. Aynı şekilde, insanlar AI eğiminde boğulurlarsa, AI: “Hakem” in internette eğitilmiş AI modelleri muhtemeldir. Çöp üretmek.

Jon RoozenbeekPsikoloji Öğretim Üyesi, Cambridge Üniversitesi; Sander van der LindenToplumda Sosyal Psikoloji Profesörü, Cambridge ÜniversitesiVe Yara KyrychenkoDoktora Adayı, Cambridge Sosyal Karar Verme Laboratuvarı, Cambridge Üniversitesi

Bu makale şuradan yeniden yayınlanmıştır. Konuşma Creative Commons lisansı altında. Oku orijinal makale.

1

2025’te dünyada kaç ülke var?

619 kez okundu

1

2025’te dünyada kaç ülke var?

619 kez okundu

2

Bilim adamları, havadan co₂ yakalayan canlı yapı materyali yaratıyor

463 kez okundu

2

Bilim adamları, havadan co₂ yakalayan canlı yapı materyali yaratıyor

463 kez okundu

3

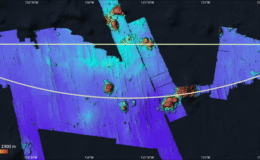

Hawaiʻi Abyssal Nodüller ve İlişkili Ekosistemler Expedition

273 kez okundu

3

Hawaiʻi Abyssal Nodüller ve İlişkili Ekosistemler Expedition

273 kez okundu

4

Porsuk Zeyve Höyük’teki Hitit dönemine ait 3500 Yıllık Kerpiç Yapılar

253 kez okundu

4

Porsuk Zeyve Höyük’teki Hitit dönemine ait 3500 Yıllık Kerpiç Yapılar

253 kez okundu

5

Jurnal ve Jurnalcilik ne demek? Osmanlı’dan günümüze ihbarcılık

216 kez okundu

5

Jurnal ve Jurnalcilik ne demek? Osmanlı’dan günümüze ihbarcılık

216 kez okundu